许志钦:理解神经网络训练过程

作者

上海交通大学,许志钦:https://ins.sjtu.edu.cn/people/xuzhiqin/pub.html

F-Principle

频率原则可以用一句话概括:深度学习倾向于优先拟合目标函数的低频部分

神经网络的特点:

- OverParameter:参数富集,能力上限很强,理论上可以拟合任何分布,也意味着它可以使用很多种参数组合来拟合相同的分布

- 但是在它的能力中,具有较好泛化性能的参数组合只是一小部分

-

为什么神经网络的学习效果比传统方法好?

- 神经网络从低频开始匹配,传统方法从高频开始匹配

-

输入数据的噪声同时存在于高、低频,但是数据的低频能量往往会比较大,所以在低频神经网络学习到了更多有用的信息,效果更好。

-

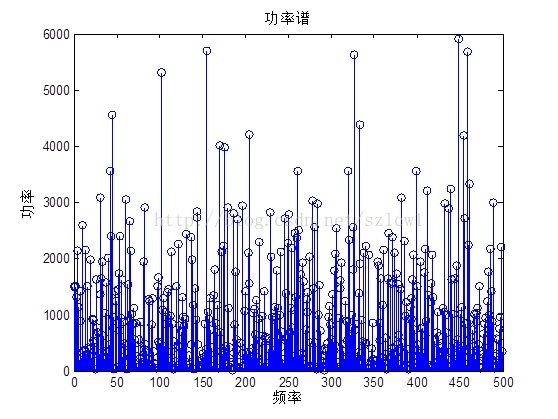

高斯白噪声功率谱

-

过拟合现象的解释:当不停地训练网络,它会开始倾向于学习一些高频信息,这时噪声的影响更大,神经网络的性能开始变差

深度加速效应

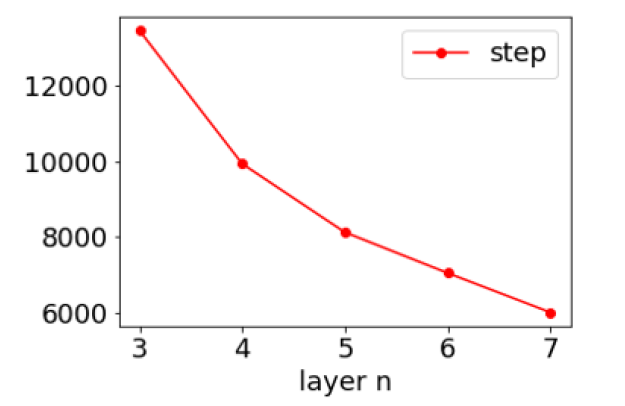

- 人们在运用中发现,更深层的神经网络往往比隐藏层较少的神经网络训练得快,也有更好的泛化性能

越深的网络,达到某个固定精度的速度往往越快

Deep Frequency Principle——更深层神经网络的有效目标函数在训练的过程中会更趋近于低频。

评论