Author

- Ramin Nabati

- Qi Hairong

- From: Department of Electrical Engineering and Computer Science The University of Tennessee Knoxville, USA

Abstract

- 背景:目前在最先进的两阶段法的目标检测网络中,候选区域搜索算法成为了一个影响速度的主要原因

- 我们的工作:

- 提出了RRPN,利用雷达信息实时提供候选区域搜索框的算法

- 使用Fast-RCNN在nuSence上测试,我们的算法速度比对比对象快了100多倍

- 并且同时具有更高的精度和召回率

Introduction

radar的应用

- [4]:最早提出想用radar的一批人提出了一些应用方式,但是很无奈,早期缺乏雷达数据集缺乏没法做

2D目标检测网络

-

[2,5,6,7]:借助于CNN,2D的目标检测近些年来进展巨大。这些方法主要分为了两类:一阶段法和二阶段法

-

[8]:一阶段法将目标检测看作一个回归任务,直接从图像学习目标类的概率和检测框

- [9]:YOLO

- [7]: SSD

-

[2,6]: 两阶段法,在第一阶段使用RPN(region proposal networks)生成ROI区域,然后在第二阶段应用这些区域进行分类回归

一阶段法的准确率低但是速度往往比较快,二阶段法的”瓶颈“是RPN,它需要对单张图片生成ROI区域来进行后续检测

Related Work

雷达相关工作

-

[10]: 雷达导航,EKF

-

[11]:一种基于相关的模式匹配算法,加上距离窗口来检测和跟踪车辆前方的目标。

-

[12]:Ji等人提出了一种基于雷达检测的注意力选择系统。利用雷达检测来选择候选目标并且生成一个窗口分别进行识别

融合相关工作

-

[13]:提出了一个基于激光雷达和视觉的行人检测系统,使用了集中和分散的融合架构。在前者中,作者提出了一种特征级融合系统,将来自激光雷达和视觉空间的特征合并到一个向量中,并使用单一分类器进行分类。后者采用两个分类器,每个传感器和特征空间一个分类器。

-

[14]:Choi等人提出了一种多传感器融合系统,解决了汽车上集成的14个传感器的融合问题。该系统使用扩展卡尔曼滤波器处理来自单个传感器的观测结果,能够检测和跟踪行人、自行车和车辆。

基于视觉的目标推荐算法

在目标检测网络中,基于视觉的目标提议算法是一种非常流行的算法。

- [3]:选择性搜索算法,通过使用多种互补的图像分区来实现对目标的多样化搜索。尽管有很高的准确性,选择性搜索在计算上是昂贵的,每幅图像运行2-7秒。

- [15]:边缘盒是另一种基于视觉的对象建议算法,使用边缘来检测对象。Edge Boxes比选择性搜索算法要快,每幅图像的运行时间为0.25秒,但在自动驾驶等实时应用中,它仍然被认为是非常慢的。

RADAR REGION PROPOSAL NETWORK

利用雷达来进行region proposal,不仅能够加快算法的速度,还能利用雷达具有的距离和位置信息来标记识别的目标。

RRPN实际上还提供了一种注意力机制,它使得计算资源集中在重要的区域上。

RRPN包括三个步骤:视角转换、锚点生成和距离补偿,每一个都将在下面的章节中单独讨论。

视角转换

第一步就是要把雷达点在图像上标记出来,我们使用投影的方式。雷达一般是鸟瞰图(图1(a))的形式

3D point : P = [X; Y; Z; 1]

its image:p = [x; y; 1]

则他们之间的转换关系一般为下式

其中H是根据相机位置得到的参数

锚点生成

投影之后的雷达点叫做POI(point of interest),它提供了目标在像平面内很有价值的信息,接下来我们要在POI附近生成ROI。但是还有两个问题:

- POI往往不是刚好在目标的中心的、

- 雷达并不提供检测到的目标的尺寸信息,如果我们采用固定大小的检测框那样就不是很有效了。

我们利用了Fast-RCNN生成锚点检测框的思想来缓解以上问题,做法是:

- 以POI为中心生成不同大小和不同长宽比的检测框,如图1(b),我们总共用了4种不同大小和3种不同长宽比的检测框

- 由于POI不是经常在中心,我们还采用了不同的偏移版本,如图1(c-e)

距离补偿

目标在像平面中的大小与他们的距离直接相关,这也决定了锚点检测框的大小应该是多少,我们利用雷达刚好可以方便地获得距离,所以我们利用下列公式来修正锚点检测框

实验及结果

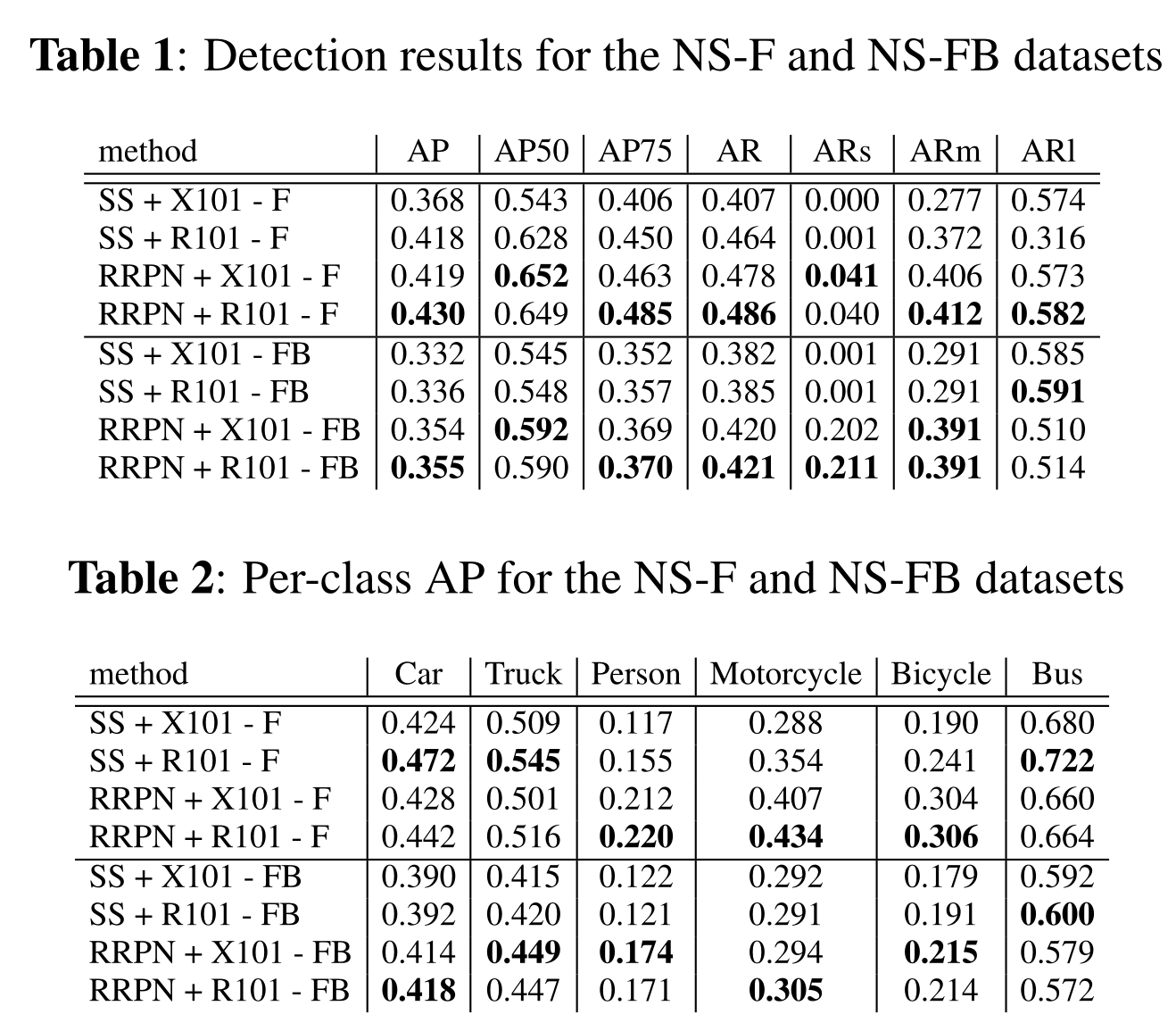

数据集

- 数据集:nuScenes

- 测试类:汽车、卡车、人、摩托车、自行车和公共汽车

- 两部分:NS-F来自前视,目标比较远;NS-FB来自后视,难度更大

- 训练-测试:0.85-0.15

实施细节

-

RRPN+Fast-RCNN

-

主干:两个不同的 ResNet-101, 记为R101 and ResNeXt-101, 记为X101

-

训练阶段:先从COCO数据集上预先训练

-

和SS(Selective Search algorithm)选择搜索算法进行了比较

结果

AP,AR都有所上升。